Xiaomi công bố mã nguồn mở Xiaomi-Robotics-0, mô hình AI thân thể 4,7 tỷ tham số với độ trễ suy luận 80ms và điều khiển thời gian thực 30Hz, chạy trên RTX 4090.

Xiaomi công bố mô hình AI thân thể Xiaomi-Robotics-0 mã nguồn mở

Ngày 12 tháng 2, nhà sáng lập Xiaomi, Lei Jun, thông báo phát hành mã nguồn mở Xiaomi-Robotics-0, một mô hình Vision-Language-Action (VLA) với 4,7 tỷ tham số. Mã nguồn, trọng số mô hình và tài liệu kỹ thuật hiện đã có trên GitHub và Hugging Face.

Kiến trúc mô hình và hiệu năng nổi bật

Mô hình sử dụng kiến trúc Mixture-of-Transformers, tách biệt giữa Vision-Language Model (VLM) và một Transformer phân tán 16 lớp (DiT). Phần VLM đảm nhiệm hiểu lệnh và suy luận không gian, trong khi "vỏ não vận động" DiT tạo ra các chuỗi chuyển động liên tục tần số cao qua phương pháp flow matching.

Kiến trúc này cung cấp độ trễ suy luận chỉ 80ms, hỗ trợ điều khiển thời gian thực 30Hz và có thể chạy trực tiếp trên GPU tiêu dùng như RTX 4090.

Quá trình huấn luyện hai giai đoạn

-

Giai đoạn 1: Cơ chế đề xuất hành động bắt buộc VLM dự đoán đồng thời phân phối hành động đa phương thức trong quá trình hiểu hình ảnh, đồng bộ hóa không gian đặc trưng và hành động.

-

Giai đoạn 2: Khóa VLM bất biến, chỉ huấn luyện DiT để sinh ra các chuỗi chuyển động chính xác.

Cải tiến sau huấn luyện và hiệu quả trên các bộ dữ liệu

Sau huấn luyện, mô hình bổ sung suy luận không đồng bộ và chiến lược che độ tập trung hình chữ Λ, giúp tách biệt thời gian suy luận và thực thi đồng thời ưu tiên phản hồi hình ảnh hiện tại.

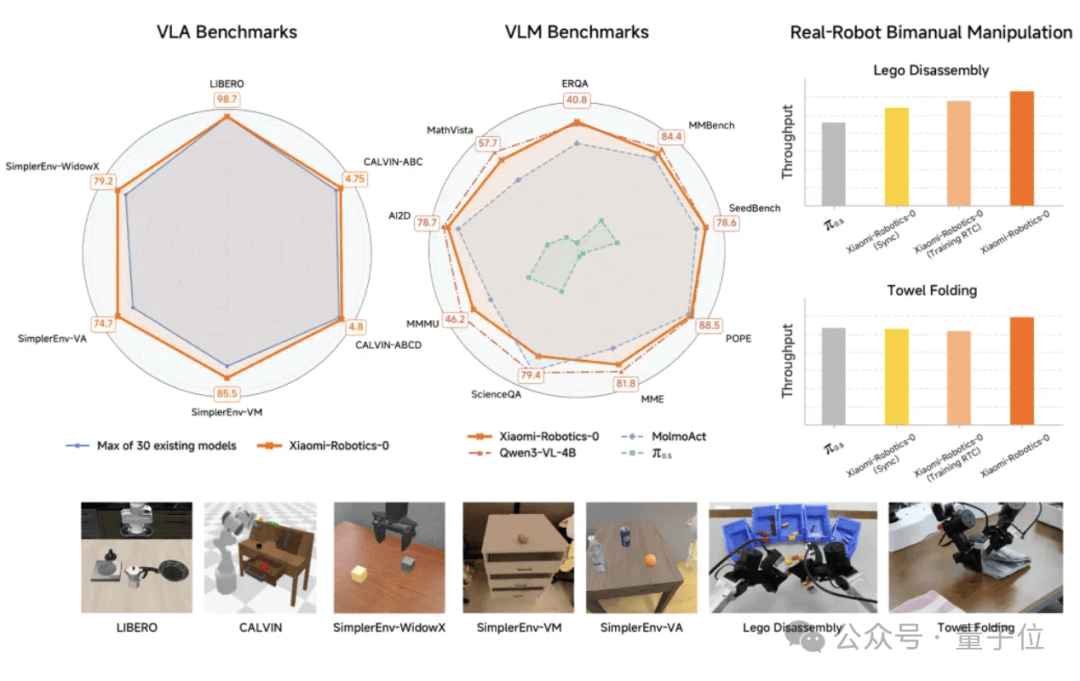

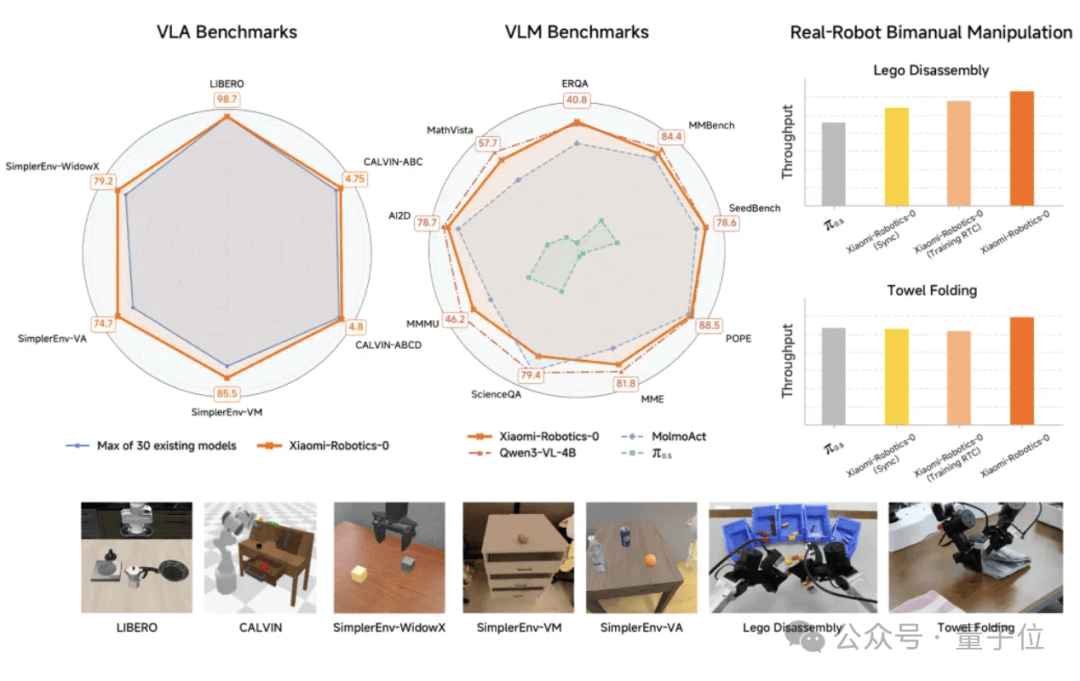

Trong mô phỏng, Xiaomi-Robotics-0 vượt trội hơn 30 mô hình chuẩn như π0, OpenVLA, RT-1 và RT-2 trên các bộ dữ liệu LIBERO, CALVIN và SimplerEnv, đạt nhiều kết quả mới tốt nhất thế giới (SOTA). Trên nhiệm vụ Libero-Object, mô hình đạt tỷ lệ thành công 100%.

Ứng dụng thực tế với robot hai cánh tay

Trong triển khai thực tế, robot hai cánh tay chạy trên mô hình này thể hiện khả năng phối hợp tay-mắt ổn định trong các nhiệm vụ phức tạp, tầm nhìn dài như tháo lắp khối và gập khăn, đồng thời duy trì năng lực phát hiện vật thể và trả lời câu hỏi dựa trên hình ảnh.

Nguồn: QbitAI

Bình luận (0)

Hãy là người đầu tiên bình luận trong bài

Đăng nhập Đăng nhập để bình luận trong bài viết này