Ant Group Mở Mã Nguồn Mô Hình Đa Phương Thức Toàn Diện Ming-Flash-Omni 2.0

AI phân tích 5

Các điểm chính được AI trích xuất từ bài viết

-

1

Ant Group mở mã nguồn Ming-Flash-Omni 2.0

Ant Group đã công bố mã nguồn mở cho mô hình đa phương thức lớn Ming-Flash-Omni 2.0, nổi bật trong các lĩnh vực như nhận thức ngôn ngữ hình ảnh, tạo giọng nói và chỉnh sửa hình ảnh. Mô hình...

-

2

Kết cấu và ưu điểm của Ming-Flash-Omni 2.0

Ming-Flash-Omni 2.0 được xây dựng trên kiến trúc Ling-2.0 (MoE, 100B-A6B) với ba mục tiêu chính: cải thiện thị giác, thính giác và khả năng tạo dựng. Mô hình tích hợp hàng trăm triệu mẫu dữ liệu và chiến lược...

-

3

Thách thức của hệ thống đa phương thức toàn diện

Các hệ thống đa phương thức toàn diện thường gặp khó khăn trong việc cân bằng giữa khả năng tổng quát hóa và chuyên biệt hóa. Mặc dù mô hình đa phương thức có thể phối hợp sâu sắc giữa...

-

4

Đầu tư dài hạn vào AI đa phương thức của Ant Group

Ant Group đã đầu tư nghiên cứu AI đa phương thức toàn diện trong nhiều năm, với dòng mô hình Ming-Omni tiến hóa qua các giai đoạn. Các phiên bản sớm xây dựng nền tảng đa phương thức thống nhất,...

-

5

Tương lai và kế hoạch phát triển của Ming-Flash-Omni

Zhou Jun, trưởng nhóm mô hình Ling, nhấn mạnh tầm quan trọng của việc tích hợp sâu và phối hợp hiệu quả các khả năng đa phương thức thông qua một kiến trúc thống nhất. Sau khi phát hành mã...

Ant Group chính thức công bố mã nguồn mở Ming-Flash-Omni 2.0

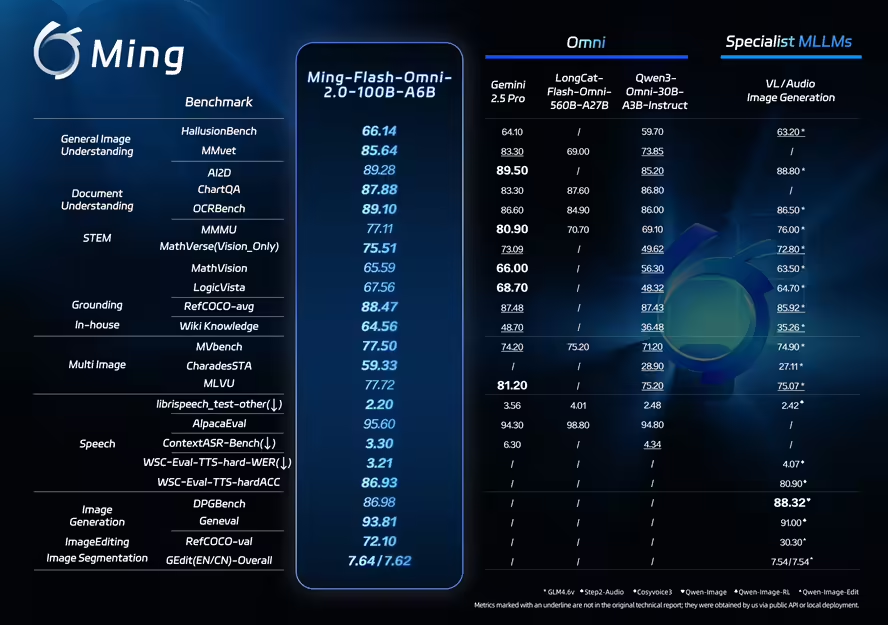

Ngày 11 tháng 2 — Ant Group vừa công bố mã nguồn mở cho mô hình đa phương thức lớn toàn diện Ming-Flash-Omni 2.0, cho thấy hiệu suất nổi bật trên nhiều tiêu chuẩn công khai trong các lĩnh vực nhận thức ngôn ngữ hình ảnh, tạo giọng nói kiểm soát được và tạo dựng hay chỉnh sửa hình ảnh.

Mô hình tạo âm thanh đa cảnh duy nhất trong ngành

Theo thông tin từ công ty, Ming-Flash-Omni 2.0 là mô hình tạo âm thanh thống nhất duy nhất trong ngành, có khả năng tạo ra giọng nói, hiệu ứng âm thanh môi trường và nhạc trong một bản âm thanh duy nhất. Người dùng có thể dùng câu lệnh ngôn ngữ tự nhiên để điều khiển chính xác âm sắc giọng nói, tốc độ, cao độ, âm lượng, cảm xúc và giọng địa phương.

Trong quá trình suy diễn, mô hình đạt tần số khung hình cực thấp 3.1Hz, giúp tạo âm thanh dài đến vài phút với độ trung thực cao và thời gian thực, đồng thời giữ hiệu suất và chi phí hàng đầu.

Thách thức trong các hệ thống đa phương thức toàn diện

Những chuyên gia trong ngành nhận định mô hình đa phương thức cuối cùng sẽ hội tụ về kiến trúc thống nhất, cho phép phối hợp sâu sắc hơn giữa các phương thức và nhiệm vụ. Tuy nhiên, các hệ thống gọi là "đa phương thức toàn diện" thường gặp khó khăn trong việc cân bằng giữa khả năng tổng quát hóa và chuyên biệt hóa, khi các mô hình mã nguồn mở thường có hiệu suất thấp hơn so với các mô hình chuyên dụng trong lĩnh vực cụ thể.

Đầu tư dài hạn và sự phát triển của dòng Ming-Omni

Ant Group đã đầu tư nghiên cứu AI đa phương thức toàn diện trong nhiều năm. Dòng mô hình Ming-Omni tiến hóa theo giai đoạn: các phiên bản sớm xây dựng nền tảng đa phương thức thống nhất, các bản trung gian xác nhận lợi ích khi mở rộng quy mô, và phiên bản 2.0 mới nhất sử dụng tập dữ liệu lớn hơn cùng tối ưu hóa huấn luyện hệ thống để nâng tầm khả năng hiểu và tạo đa phương thức lên mức dẫn đầu mã nguồn mở — vượt trội hơn các mô hình chuyên biệt hàng đầu trong một số lĩnh vực.

Bằng việc mở mã nguồn Ming-Flash-Omni 2.0, Ant Group cung cấp khả năng cốt lõi như nền tảng có thể tái sử dụng, mang đến cho nhà phát triển một điểm vào duy nhất để xây dựng ứng dụng đa phương thức đầu cuối.

Kết cấu và các ưu điểm chính của mô hình

Mô hình xây dựng trên kiến trúc Ling-2.0 (MoE, 100B-A6B) và tối ưu với ba mục tiêu chính: thị giác sắc nét hơn, thính giác tinh tế hơn và tạo dựng ổn định hơn.

- Thị giác: tích hợp hàng trăm triệu mẫu dữ liệu tinh vi và chiến lược huấn luyện các trường hợp khó, cải thiện đáng kể nhận diện các loài gần giống, chi tiết thủ công tinh xảo và hiện vật văn hóa quý hiếm.

- Âm thanh: cho phép tạo giọng nói, hiệu ứng âm thanh và nhạc trong cùng một bản nhạc; hỗ trợ điều khiển thông số giọng bằng ngôn ngữ tự nhiên chi tiết, cùng khả năng sao chép và tùy biến giọng nói không cần huấn luyện trước (zero-shot).

- Hình ảnh: nâng cao độ ổn định trong các tác vụ chỉnh sửa phức tạp, hỗ trợ điều chỉnh ánh sáng, thay đổi cảnh, tối ưu tư thế và chỉnh sửa một nhấp chuột, giữ vững tính nhất quán hình ảnh trong các tình huống động.

Phát biểu từ đội ngũ phát triển và kế hoạch tương lai

Zhou Jun, trưởng nhóm mô hình Ling, chia sẻ cốt lõi của công nghệ đa phương thức toàn diện nằm ở việc tích hợp sâu và phối hợp hiệu quả các khả năng đa phương thức thông qua một kiến trúc thống nhất. Sau khi phát hành mã nguồn mở, các nhà phát triển có thể tái sử dụng các khả năng về thị giác, giọng nói và tạo dựng trong cùng một framework, giúp giảm đáng kể độ phức tạp và chi phí khi phải kết nối nhiều mô hình riêng lẻ.

Trong tương lai, nhóm dự định nâng cao khả năng hiểu theo thời gian của video, cải tiến chỉnh sửa hình ảnh phức tạp và tạo âm thanh dài thời gian thực, đồng thời tinh chỉnh các công cụ và hệ thống đánh giá nhằm thúc đẩy triển khai thương mại quy mô lớn nhanh chóng.

Tài nguyên và trải nghiệm người dùng

Trọng số mô hình và mã suy diễn của Ming-Flash-Omni 2.0 hiện đã có trên Hugging Face và các nền tảng mã nguồn mở khác. Người dùng cũng có thể thử nghiệm mô hình qua nền tảng Ling Studio của Ant.

Nguồn: IT Home

Bài viết hay? Ấn để tương tác

Bình luận (0)

Hãy là người đầu tiên bình luận trong bài

Đăng nhập Đăng nhập để bình luận trong bài viết này